Есть ли будущее у законов робототехники Айзека Азимова?

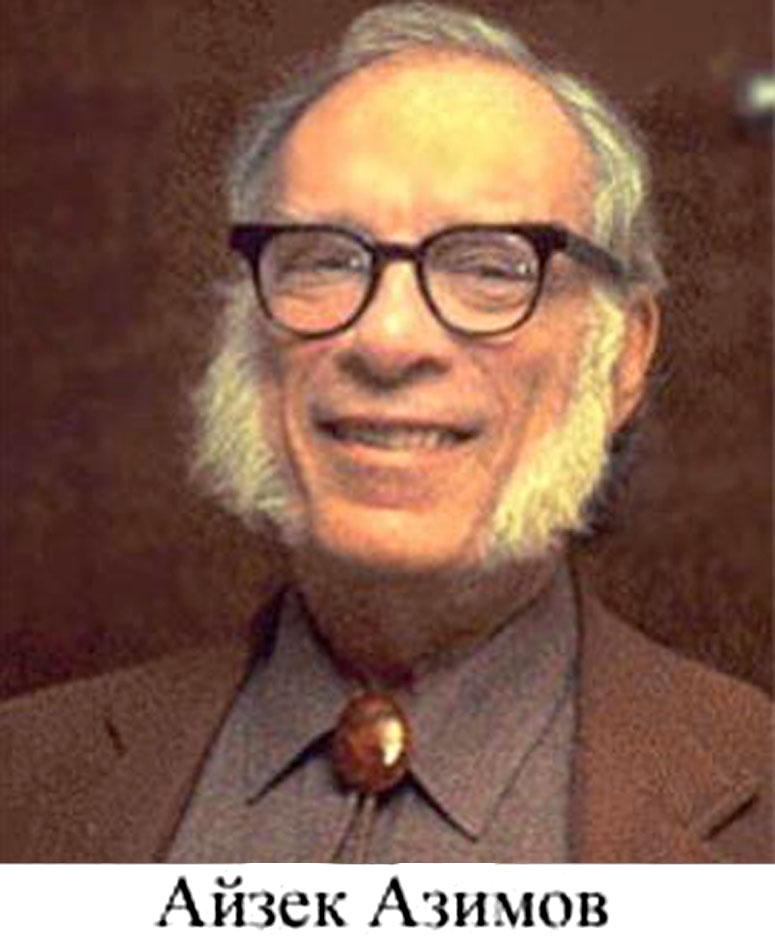

6 апреля исполнилось 20 лет со дня смерти великого Айзека Азимова. Он написал более пятисот книг, но помнят его в основном благодаря историям о роботах, которые он сочинял с 19 лет. Изложенные в них идеи — по сей день отправная точка любого рассуждения о месте умных машин среди людей.

6 апреля исполнилось 20 лет со дня смерти великого Айзека Азимова. Он написал более пятисот книг, но помнят его в основном благодаря историям о роботах, которые он сочинял с 19 лет. Изложенные в них идеи — по сей день отправная точка любого рассуждения о месте умных машин среди людей.

Причём сегодня это уже не теоретические разглагольствования. Роботы трудятся на складах и заводах. Южная Корея планирует сделать их тюремщиками. Автономный автомобиль корпорации Google на днях прокатил слепого человека. США, Южная Корея, Израиль и др. массово разрабатывают военные беспилотные летательные аппараты и автономных наземных роботов. Многие из них вооружены. Не за горами тот день, когда жизнь человека повиснет на кончике полупроводниковых схем и математических алгоритмов. Наконец, роботов обожают дети.

Причём сегодня это уже не теоретические разглагольствования. Роботы трудятся на складах и заводах. Южная Корея планирует сделать их тюремщиками. Автономный автомобиль корпорации Google на днях прокатил слепого человека. США, Южная Корея, Израиль и др. массово разрабатывают военные беспилотные летательные аппараты и автономных наземных роботов. Многие из них вооружены. Не за горами тот день, когда жизнь человека повиснет на кончике полупроводниковых схем и математических алгоритмов. Наконец, роботов обожают дети.

В 1939-м, когда Азимов занялся этой темой, роботы были довольно новой идеей, а слово для них родилось в том же 1920 году, что и писатель, — в пьесе чешского драматурга Карела Чапека. На обложках бульварного чтива, которое продавалось в семейном магазине сладостей, маленький Айзек видел немало зловещих рисунков взбесившихся машин, нападающих на своих создателей и полураздетых женщин. Впоследствии Азимов относился к роботам сочувственно. «Его необходимо спроектировать так, чтобы он соответствовал определённым стандартам безопасности, как и любая другая машина, созданная разумным технологическим обществом, — писал он в 1980 году. — Поэтому я начал писать рассказы о роботах, которые не просто были хорошими: они были хорошими, потому что не могли стать другими».

По мотивам первых рассказов Азимова его редактор Джон Кэмпбелл из Astounding Science-Fiction составил список правил, которым подчинялись роботы. Они и стали тремя законами робототехники. 1) Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред. 2) Робот должен выполнять приказы человеческих существ, за исключением тех случаев, когда эти приказы противоречат первому закону. 3) Робот должен защищать своё существование, за исключением тех случаев, когда такая защита будет противоречить первому или второму закону.

Законы были ясными, прямыми и логичными, но впоследствии Азимов написал несколько рассказов, в которых показал, с какой лёгкостью они могут потерпеть неудачу. Например, робот, обладающий телепатией, лжёт, дабы не причинить боль человеку, но в конечном итоге он всё-таки разбивает сердце героини («Лжец»). В другом произведении робот, приближаясь к опасному месту, отступает, дабы защитить себя, после чего снова начинает выполнять приказы. И так до бесконечности, пока человек не нарушает цикл, намеренно ставя себя в опасное положение и вынуждая робота спасти его («Хоровод»).

Роботы Азимова адаптивны, иногда они даже перепрограммируют себя. Один развивает эмоциональную привязанность к своему создателю. Другой находит логическое обоснование для того, чтобы напасть на людей. Робот, изолированный на космической станции, решает, что людей не существует, и создаёт собственную религию. Ещё один робот подаёт в суд, требуя, чтобы его признали человеком.

В итоге ряд энтузиастов предложил новые правила. Один заставил роботов всегда считать себя роботами. Другой предположил, что роботы должны убивать только вражеских солдат и т. д. Скорее всего, прав Майкл Анисимов из организации Singularity Institute for Artificial Intelligence (США), который утверждает, что любой набор правил всегда будет содержать конфликты и серые зоны. Кроме того, отмечает эксперт, робот может злоупотреблять законами в сложных ситуациях, особенно если он не понимает, почему был создан такой закон. А раз роботы могут себя перепрограммировать, они будут менять правила неожиданным образом, дабы приспособиться к новым обстоятельствам.

Вместо того чтобы вводить правила, г-н Анисимов предлагает создать «дружественный ИИ», который будет любить человечество.

Нынешние роботы, способные принимать самостоятельные решения, и впрямь требуют иного набора правил, подчёркивают Робин Мёрфи из Техасского университета A&M и Дэвид Вудс из Университета штата Огайо (оба — США). В 2009 году они предложили три других закона. 1) Поскольку именно люди создают роботизированные системы, система «человек — робот» должна отвечать высоким стандартам безопасности и этическим нормам. 2) Роботы должны подчиняться, но только ограниченному числу людей. 3) Роботы должны защищать себя, но только после того, как они полностью передадут контроль над выполняемой операцией (например, управление автомобилем) человеку.

Дискуссия продолжается. В 2007 году Южная Корея объявила о планах опубликовать хартию, посвящённую этике в системе отношений между человеком и роботом. Вполне вероятно, важной частью документа станут такие темы, как психологическая зависимость от роботов (подобно зависимости от видеоигр или смартфонов), секс между человеком и роботом и т. д. Аналогичные вопросы рассматривает организация European Robotics Research Network.

Эти проблемы обсуждались бы и без Айзека Азимова. Но именно его три закона и его исследование границ этих законов начали нынешнюю дискуссию.

по информации: lenta.ru